IA en recrutement : si un candidat, un syndicat ou un régulateur vous posait la question aujourd'hui, pourriez-vous défendre vos outils ?

RGPD, AI Act, arrêt SCHUFA, Robo-Firing case : ce que les entreprises doivent savoir avant qu'on leur pose la question.

PSL Avocat

4/12/20264 min temps de lecture

IA en recrutement : si un candidat, un syndicat ou un régulateur vous posait la question aujourd'hui, pourriez-vous défendre vos outils ?

Philippe Sigal

Tech & Business Law Attorney | Avocat | Paris & Barcelona | Legal Ops

April 9, 2026

Dans la plupart des échanges que j'ai avec des DRH et des cabinets de recrutement, la réponse honnête est non.

Pas par manque de diligence. Par effet de vitesse.

Les outils ont été déployés. L'analyse juridique n'a pas suivi.

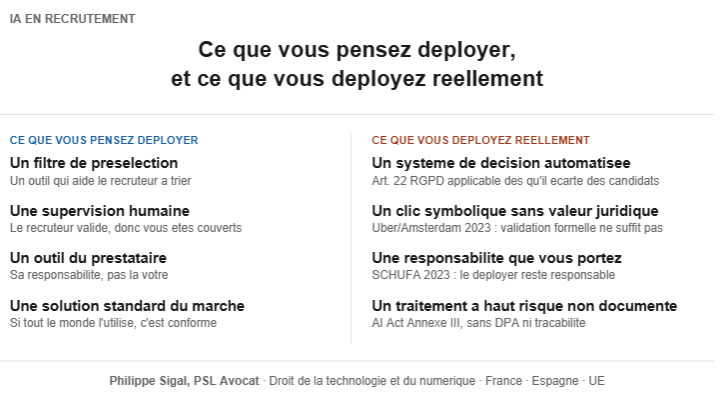

Ce que vous déployez réellement

Quand vous activez un outil d'IA en recrutement, vous ne déployez pas un filtre.

Vous déployez un système de décision qui trie et classe des candidats, en écarte certains, sur la base d'algorithmes que vous ne contrôlez pas, entraînés sur des données que vous n'avez pas auditées, parfois hébergées hors UE.

En droit de l'UE, cela correspond à une décision automatisée dans un contexte d'emploi. C'est l'un des cadres les plus sensibles du droit.

Et si vous êtes cabinet RH externe : vous n'êtes pas un simple intermédiaire. Vous entrez dans la chaîne de responsabilité. La question de qui est responsable de quoi est rarement tranchée dans les contrats. Elle doit l'être.

Ce que dit déjà le droit, trois décisions clés

1. CJUE, 7 décembre 2023, SCHUFA Holding (C-634/21)

Arrêt clé de la Cour de justice de l'UE sur l'article 22 du RGPD. La question : un score produit automatiquement par un algorithme, sur lequel un tiers s'appuie fortement pour décider, constitue-t-il une "décision automatisée" ?

Réponse : oui. Même si c'est un tiers qui prend la décision finale.

➡️ Si votre outil détermine quels candidats arrivent devant le recruteur, vous êtes dans le champ de l'article 22.

2. Cour d'appel d'Amsterdam, 4 avril 2023, Drivers v. Uber et Ola (connu aussi comme le "Robo-Firing case")

Uber arguait avoir des "humains dans la boucle" pour valider les décisions algorithmiques. La Cour a rejeté cet argument : la validation n'était "rien de plus qu'un acte purement symbolique". Décision illégale au sens de l'article 22 du RGPD. En octobre 2023, Uber n'ayant pas obtempéré, le tribunal a ordonné 584 000 euros de pénalités.

➡️ Le clic humain ne vous protège plus. La supervision doit être réelle, documentée, et capable d'infléchir le résultat.

3. Audiencia Nacional espagnole, 4 juillet 2025, CGT c/ Foundever Spain (rec. 182/2025)

L'entreprise nie utiliser des algorithmes dans la gestion RH. Deux décisions antérieures de la même juridiction avaient pourtant déjà établi le contraire. La Cour déclare nulle la pratique, condamne à une indemnisation pour atteinte à la liberté syndicale, et ordonne la communication de l'information.

➡️ Nier l'existence d'un algorithme RH quand il existe est une faute autonome. Le risque est juridique, social et réputationnel.

Ce que disent les régulateurs

La CNIL en France et l'AEPD en Espagne ont toutes deux publié des positions claires sur l'usage de l'IA en RH. Leurs conclusions convergent : une supervision humaine réelle et non symbolique est requise pour toute décision significative. C'est exactement la formulation retenue par la Cour d'appel d'Amsterdam.

Ce que je vois en pratique

Dans les échanges que j'ai avec des DRH et des responsables juridiques, les mêmes angles morts reviennent : outils sans cartographie consolidée ni qualification juridique, human-in-the-loop purement formel, contrats fournisseurs sans DPA ni clause AI Act, aucune traçabilité des décisions.

Dans cet état, la plupart des dispositifs ne résisteraient pas à une demande d'accès d'un candidat, une mise en demeure syndicale ou un contrôle de l'autorité de protection des données.

RGPD + AI Act : vous êtes déjà exposés

Trois obligations que la plupart des organisations ne maîtrisent pas.

Base légale : le consentement est quasi-inutilisable dans un contexte de recrutement, en raison du déséquilibre de pouvoir structurel. L'intérêt légitime est possible, mais conditionné à une analyse formalisée que la plupart n'ont pas faite.

Article 22 RGPD : depuis l'arrêt SCHUFA, un outil qui score ou classe des candidats de façon déterminante entre dans ce périmètre, même si un humain valide ensuite.

Information des candidats : vos candidats savent-ils qu'un algorithme les évalue, qu'ils peuvent demander une intervention humaine, que leurs données transitent par un prestataire hors UE ? Probablement pas.

Côté AI Act (Règlement UE 2024/1689, en vigueur depuis août 2024) : le recrutement est classé système à haut risque (Annexe III).

Le piège du Digital Omnibus

La Commission européenne a publié en novembre 2025 un paquet législatif qui va probablement repousser certaines obligations AI Act et harmoniser et simplifier certaines exigences de DPIA.

Beaucoup y voient un feu vert pour attendre.

C'est une erreur de lecture. Le recrutement restera classé haut risque. Le RGPD s'applique intégralement aujourd'hui. Et le risque ne disparaît pas : il se déplace du régulateur vers le contentieux. Et il grossit, précisément parce que le cadre se précise.

Dans 18 mois

La question ne sera plus "utilisez-vous de l'IA en recrutement ?"

Elle sera : "pouvez-vous prouver que vous l'utilisez légalement ?"

Les candidats écartés par algorithme commencent à contester. Les grands groupes imposent des clauses de conformité IA dans leurs contrats avec les prestataires RH. En Espagne, les syndicats disposent d'un droit légal d'accès aux paramètres des algorithmes, et ils s'en servent.

La conformité IA en recrutement n'est pas une contrainte administrative. C'est une condition d'accès au marché, et bientôt une clause que vos clients vous demanderont de satisfaire avant de signer.

Comment agir ?

Pour les organisations concernées, j'interviens sur trois types de sujets.

Cartographie juridique des outils IA déployés dans la chaîne de recrutement : qualification au sens du RGPD et de l'AI Act, identification des risques prioritaires, clarification de la chaîne de responsabilité.

Revue et mise à jour des contrats fournisseurs : DPA, clauses de conformité AI Act, allocation contractuelle des responsabilités.

Documentation candidats : privacy notices, mentions d'information, gestion des droits d'accès et de contestation.

Ce n'est pas de la conformité pour la conformité. C'est ce qui vous permet de répondre "oui" quand la question est posée.

Si vous êtes concernés, parlons-en.

Contact

BARREAU

contact@pslavocat.com

+34-672-939-146

© 2025-2026. tous droits réservés

Avocat à la Cour, Barreau de Paris

+33-7-71-06-80-60

Philippe Sigal

Inscrit à ICAB (collège des avocats de Barcelone)